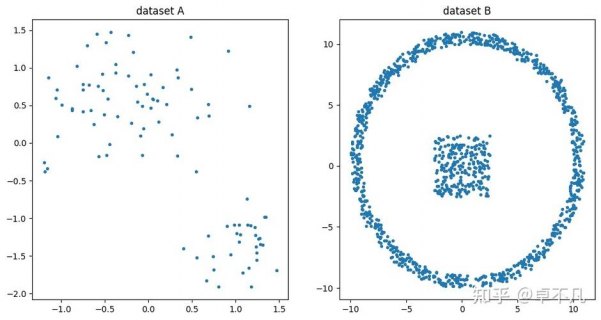

K-means聚类算法是一种常用的无监督学习算法,用于将数据集划分为多个簇(cluster),使得同一簇内的数据点彼此相似,而不同簇之间的数据点差异较大,该算法的核心思想是通过迭代计算,不断优化簇的中心位置和簇的划分,直到满足停止条件为止。

K-means聚类算法的基本步骤如下:

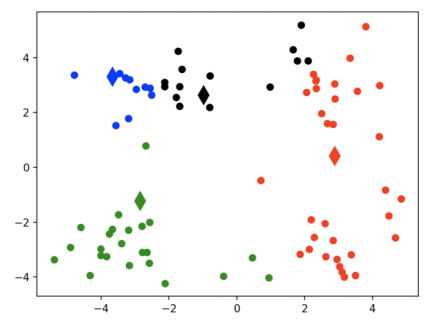

1. 初始化:选择K个初始中心点,可以是随机选择或者通过其他方法确定。

2. 分配数据点:将每个数据点分配到距离其最近的中心点的簇中。

3. 更新中心点:重新计算每个簇的中心点,通常是簇内所有数据点的均值。

4. 判断收敛性:如果中心点不再发生变化或达到最大迭代次数,则算法收敛,否则返回步骤2。

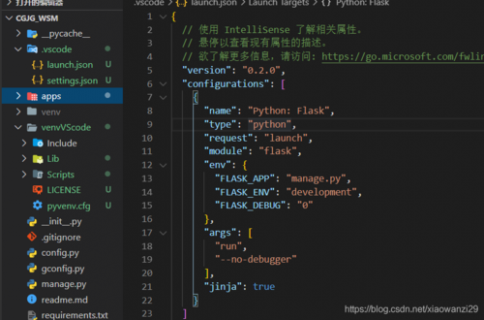

下面是一个利用Python实现K-means聚类算法的代码示例:

import numpy as np

from sklearn.cluster import KMeans

# 生成随机数据集

data = np.random.rand(100, 2)

# 设置聚类簇数

num_clusters = 3

# 创建KMeans模型并拟合数据

kmeans = KMeans(n_clusters=num_clusters)

kmeans.fit(data)

# 获取聚类结果

labels = kmeans.labels_

centers = kmeans.cluster_centers_

# 打印聚类结果和中心点坐标

print("Cluster labels:", labels)

print("Cluster centers:", centers)

上述代码使用了`sklearn`库中的`KMeans`类来实现K-means聚类算法,我们生成了一个包含100个二维数据点的随机数据集,我们设置了聚类簇数为3,接下来,我们创建了一个`KMeans`模型,并将数据集拟合到模型中,我们获取了聚类结果和每个簇的中心点坐标,并将其打印出来。

相关问题与解答:

1. K-means聚类算法如何选择合适的簇数?

答:选择合适的簇数是K-means聚类算法的一个重要问题,常见的方法包括肘部法则、轮廓系数等,肘部法则通过绘制SSE(误差平方和)随簇数变化的曲线,观察曲线的拐点来确定合适的簇数,轮廓系数则是通过比较簇内的紧密度和簇间的分离度来评估聚类效果,通常选择具有较高轮廓系数的簇数作为最佳选择,还可以使用交叉验证等方法来确定合适的簇数。

2. K-means聚类算法对初始中心点的选择敏感吗?

答:是的,K-means聚类算法对初始中心点的选择是敏感的,不同的初始中心点可能导致最终的聚类结果不同,为了解决这个问题,可以采用多次运行算法并选择最优结果的方法,或者使用一些启发式方法(如K-means++)来选择初始中心点,以减少初始中心点选择的影响。

微信扫一扫打赏

微信扫一扫打赏

笔记本关机响一声,不必过分忧心,或许是硬件的正常释放气息,关机后的响声,也许是它轻轻道别的旋律,给彼此一点理解,科技也有它的温度。

小米笔记本360度旋转设计实用又时尚,安装360软件更添便捷,两者结合,让工作和娱乐更加灵活高效。

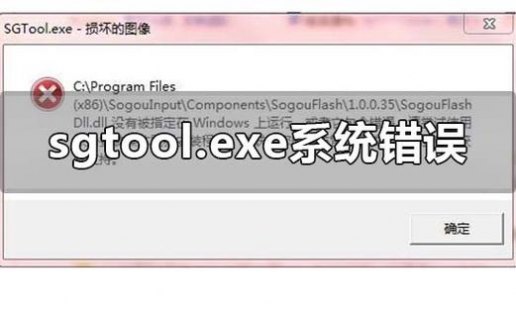

别担心,T430i安装Windows10或许有些波折,但通过升级BIOS和驱动,定能顺利迎接新系统。

ES6解构赋值巧妙地分为数组、对象、字符串及函数参数四种方式,让代码更简洁,数据操作更直观,是提升编码效率的利器。

电脑表格不能点揭示了现代办公的痛点,以幽默诙谐引人深思,技术进步中也别忘了友好互动哦!